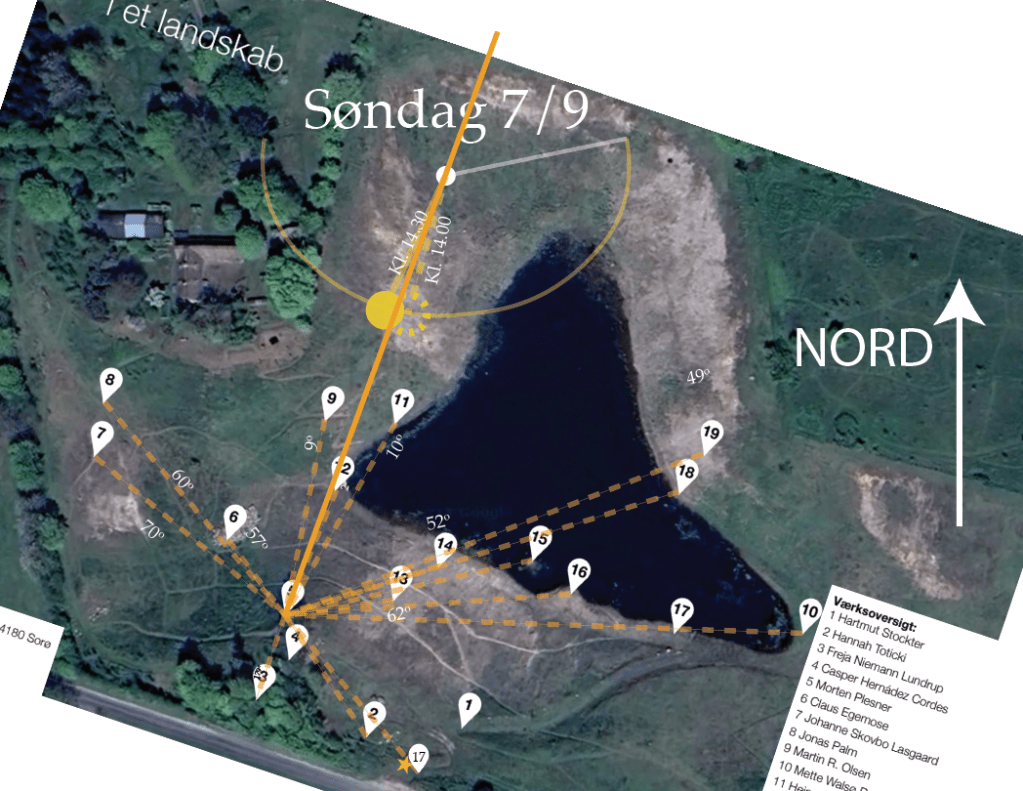

Koncert – performance 7/9 2025

Efter min performance “Korkelmens Dialekt”, blev jeg inspireret af Mortens værk med bierne. Jeg undersøgte, hvad det lige er, bier gør, når de kommunikerer, og blev mindet om, at de jo laver deres “dans”. På engelsk: “Waggle Dance”. Kort sagt går det ud på, at en bi, der har fundet en fødekilde, ved tilbagekomsten til bistaden laver en slags kodet bevægelsesmønster, som meget præcist kommunikerer 1) afstanden til, 2) retningen til og 3) beskaffenheden af fødekilden. Dansen foregår i et ottetal, på bikubens lodrette væg og retningen ift op (modsat tyngdekraften) angiver retningen af fødekilden ift solen. Varigheden af dansens midterste del angiver afstanden, således at 1 sekund svarer til ca. 1 km (alt afhængigt af vindmodstand, etc).

Dette fænomen inspirerede mig til at tænke: Jeg vil være en arbedjderbi, der laver en “waggle dance” for at fortælle fællesskabet om de forskellige (åndelige) fødekilder, denne udstilling byder på!!

Så jeg har travlt! Arbejderbitravlt! Fra min første performance er der 22 dage til at jeg skal performe denne waggle dance!

Grundideen er, at jeg sætter mobilen på min klarinet, og fra den sender en live strøm af data til computeren med klarinettens retning, op-ned og side-til-side. Og når jeg så peger i retning af et af de udstillede værker, åbner jeg for en generativ lyd-arkitektur, som jeg har programmeret til værket. Lyd-arkitektur, fordi jeg har fastlagt nogle mulige tonehøjder, varigheder, filtre, mm., som jeg kan aktivere, og påvirke med klarinettens bevægelser. Som at bevæge sig rundt i et hus og fremhæve forskellige rum, dekorationer, møbler, etc. Generativ, fordi jeg bruge styret tilfældighed, (Markov), til at variere de konkrete lydforløb, du vil høre. Lydene skabes af en modulær analog synthesiser, og på den måde har jeg et relativt begrænset instrument at lege med (begrænset ift computerens uendelige muligheder for lyd-syntese). Et godt benspænd, som fordrer kreative løsninger (hvis ikke det hele skal lyde ens!).

Nr. 3 Freja “ANDETSTEDS” & nr. 15 Dorte “ÖDE”

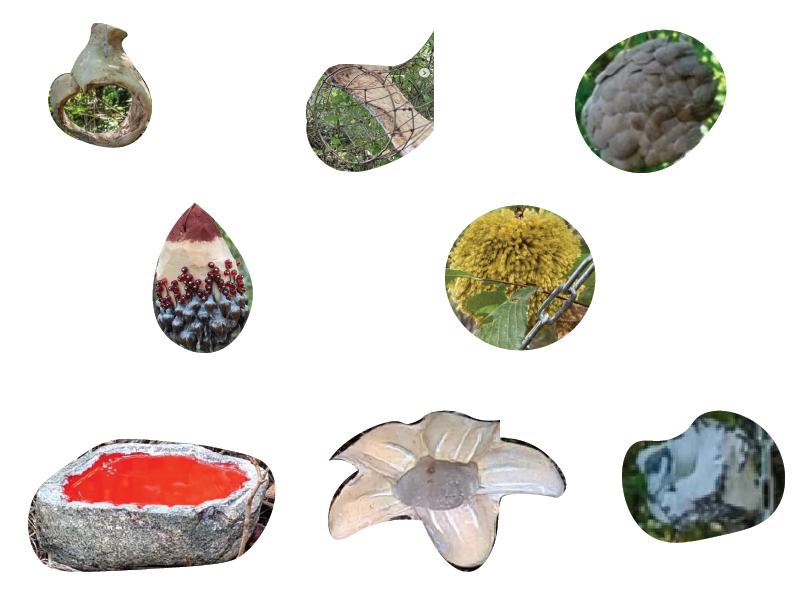

Frejas og Dortes værker er på mange måder forskellige, men de har det til fælles, at de består af en masse mindre dele, af meget forskellig beskaffenhed, som er sat samme i landskabet.

Jeg tænkte på, at jeg ville lave en slags virtuel lydskulptur ud af hvert af deres værker. Ved at bevæge klarinetten op-ned og vrikket højre-venstre kan jeg navigere rundt i lydskulpturen og aktivere forskellige dele.

Jeg lavede optagelser af de materialer, som skulpturens dele består af, og lavede en analyse af deres lydlige karakteristika.

For at kunne aktivere de forskellige lyde, som hører til de forskellige skulpturelle dele har jeg lavet en forenklet repræsentation med klare farver. Jeg sender live data fra min mobil, fastgjort til klarinetten, og når jeg bevæger klarinetten op-ned, side-side, bevæger jeg, hvad der minder om en cursor rundt i billedet; når cursoren f.eks. er over farven grøn, aktiveres den lyd, som jeg har gemt til Frejas keramiske skulptur. Osv. På den måde kan jeg bruge klarinetten som en slags trommestik, der spiller på forskellige skulpturdele..

Nr. 6 Claus “BJARNAVI TAT LOH”

Claus’ værk står som en nærmest alien efterladenskab midt i landskabet, og man tænker: “Hvad laver den der?”. Det får mig til at tænke på den sonde, mennesket har sendt ud i rummet, med nogle geometriske figurer, osv., og som jeg tænker, at en fremmed intelligens nok ikke vil fatte meget af…

Nuvel, der er ikke meget i Claus’ værks form, omtalen af det i kataloget – og da slet ikke dets titel – som giver noget hint til mig som beskuer/fremmed intelligensform.

For at finde en vej til dette værk gik jeg i ‘kødet’ på denne del af det:

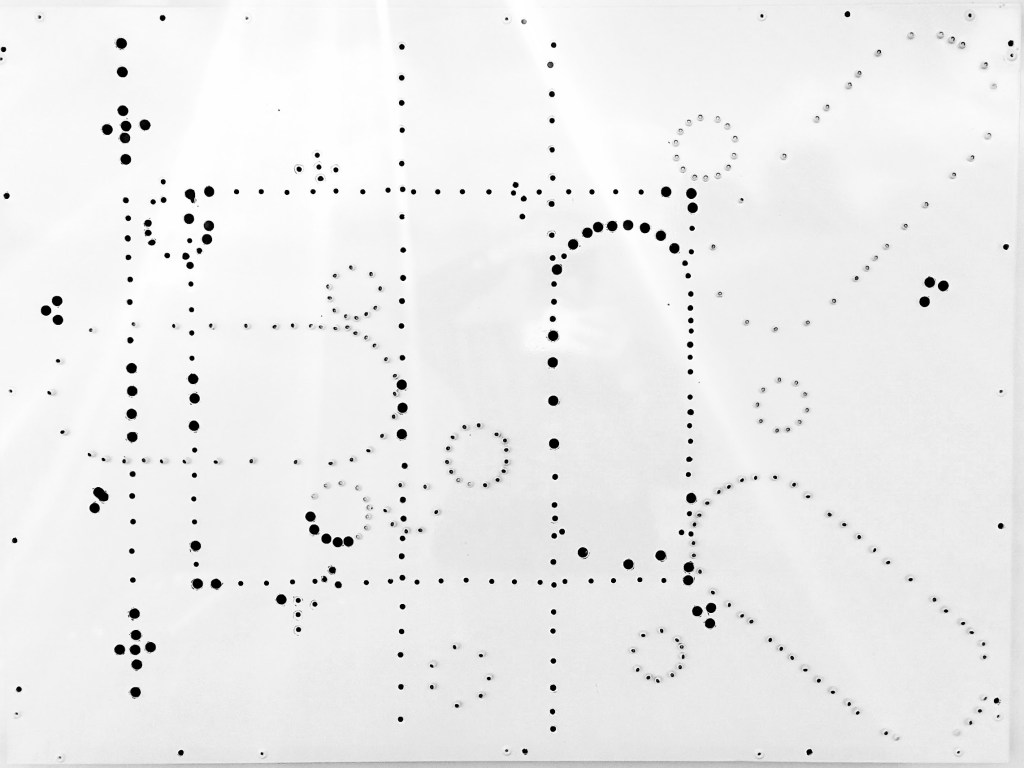

Det er en aluminiumsplade, og der er ligesom banket nogle huller i, fra den ene og den anden side. Hullerne danner figurer, som ser ud til at være placeret ud fra lodrette/vandrette og diagonale logikker. Figurene er rektangler, cirkler og rette linjer. Og så en figur, jeg ikke kendte navnet på, men som lader til (iflg. google osv) at være en såkaldt “stadium” (eng). Wikipedias illustration af denne form matcher ret godt Claus’ form:

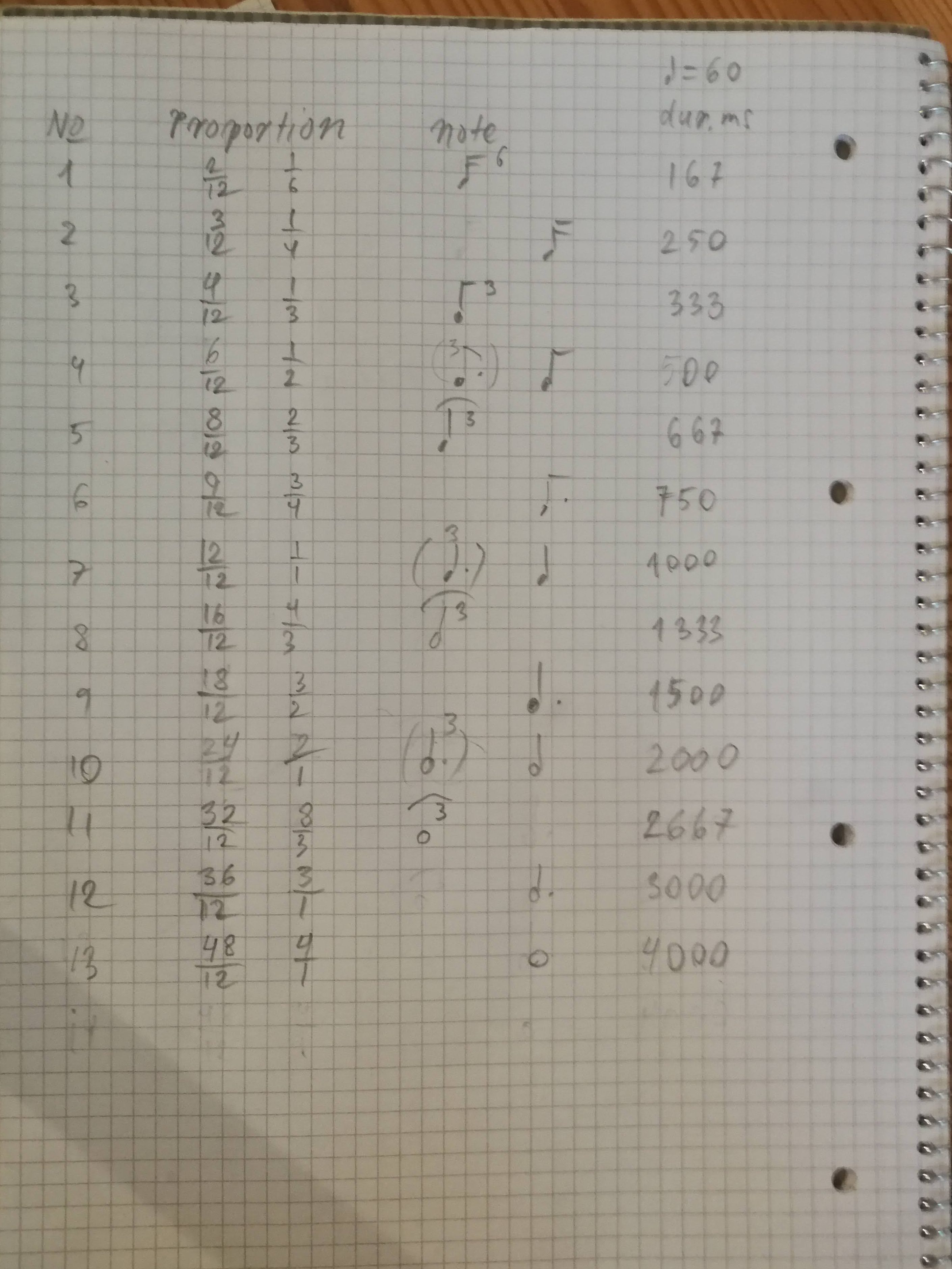

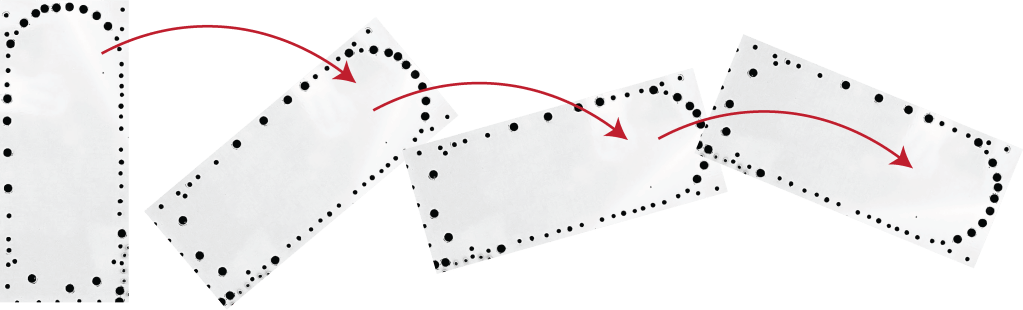

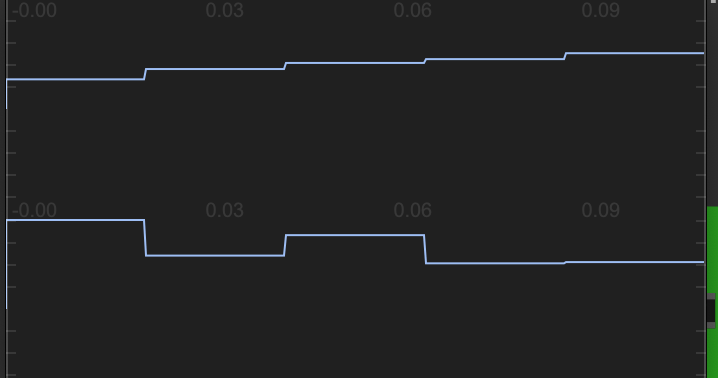

Denne form kommer i 3 forskellige stillinger: vandret, lodret og diagonalt. Jeg tænkte: lad os forestille os, at hullerne udgør toner og varigheder. Afstanden fra et hul til det næste, vandret udgør en varighed; lodret en tonehøjde. På den måde får vi et loop af toner med forskellige varigheder, dvs en melodi. Jeg forestillede mig så, at jeg kunne lade denne form->melodi eksistere virtuelt i min computer, og at jeg, med klarinettens bevægelser, kunne ‘dreje’ den rundt. På den måde, ville betydningen afstanden mellem punkterne gradvist ændre sig, og varigheder ville blive fortolket som tonehøjder og vice versa.

Dette er en tænkning, som jeg selv har fået inspiration til, ved at arbejde med analoge synthesizere. Dette er en verden af spændinger – volt – hvor den samme spænding kan bruges til det ene øjeblik at kontrollere tonehøjde, det næste varighed, det næste klang, etc.

Nr. 7 Johanne “TÅREKAR”

Johannes værk består af 5 keramik-kar. Jeg optog lyden af hvert af dem, ved (forsigt!!) at dikke til dem med fingeren. Jeg analyserede lydene og programmerede grund- og overtoner ind i maxmsp. Rent teknisk har jeg (gen)opdaget metoden wavetable synthesis. Jeg har tidligere stødt på denne metode, men har ikke oplevet den som meningsfuld for mig, indtil nu. Hvorfor? Fordi jeg har givet mig selv det kæmpestore benspænd kun at skabe lyd med (et meget primitivt) modulært synth-setup. Her har jeg kun mulighed for at sende 1 værdi ad gangen til at styre tonehøjde. Så normalt kan jeg kun får synthen til at lave 1 tone ad gangen, f.eks. et C. Hvordan så få synthen til at lave mere komplekse, overtonerige klange? Svaret er wavetable synthesis. Jeg har lavet en meget lille ‘lydoptagelse’ med kun 5 samples: grundtonen og 4 overtoner. Denne ‘lydoptagelse’ bliver så afspillet ind i synthen, hurtigt, og synthen får på den måde ‘besked’ på at spille, hvad der i langsom gengivelse ville være en arpeggio. Men hurtigt afspillet bliver de ellers adskilte toner, til én samlet klang. Lyder det som Johannes tårekar? Nok ikke helt. Men det er et bud på en dialog med værket. Og måske får klangende en klagende karakter, som går i spænd med tårekarenes essens?

Nr. 12 Hartmut “OPERATION HVEPSESALAMANDER”

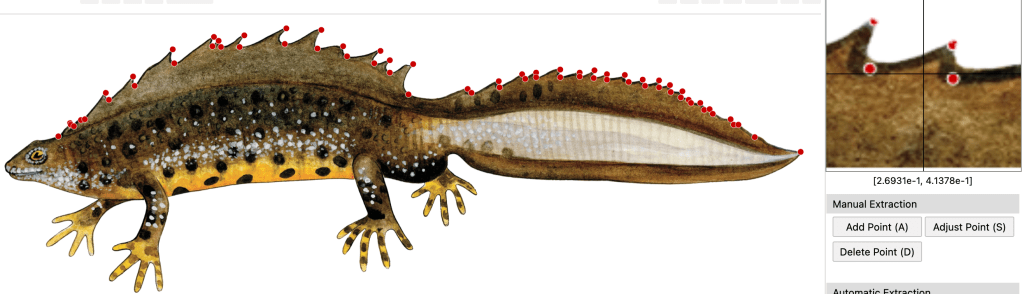

Her valgte jeg at bruge en alm Stor Salamanders ‘hanekam’, som en form til at skabe tonehøjde- og varighedsforløb. Jeg brugte softwaret https://automeris.io/wpd/, hvor man kan plotte (x,y) par ind på et billede, og trække dem ud som et datasæt.

Jeg valgte at sige x=varighed, y=tonehøjde; for hver ‘tak’ i hanekammen får du så en ‘tone’ til en melodi, hvor tonen gilder opad til et skarpt knæk; Salamanderen laver ikke lyd. Det gør hvepse til gengæld. Så for at lave en virtuel, lydlig, hvepsesalamder blev det til, at salamanderens form udgør lydarkitekturens form (dvs. melodi), og hvepsens lyde (en summen på 170 – 200 hz) udgør selve lydens klang og omfang.

Nr. 14 Regitze “IMELLEM SANDET”

Når jeg ser Regitzes skulptur, er der med det samme noget, der sker, rent lydligt. De her tentakler, eller nervetråde, eller navlestrenge, som trækkes ud af, bores ned i, eller vokser sammen med gruset får mig til at høre lyde, der bevæger sig fra skulpturens ‘hoved’ og ned i jorden. Lydarkitekturen til dette værk består derfor bla. af 5 tonebevægelser, som går oppefra – ned, i en glidende bue. Tonehøjden er bestem af skulpturens (dumpe og dybe) klang.